Anthropic, l’entreprise pionnière dans le domaine de l’intelligence artificielle, vient de franchir un nouveau cap avec la sortie de son modèle amélioré Claude 3.5 Sonnet. Cette version révolutionnaire est capable de comprendre et d’interagir avec n’importe quelle application de bureau, ouvrant ainsi la voie à une automatisation sans précédent des tâches informatiques.

Une API innovante pour automatiser les PC

Grâce à la nouvelle API « Computer Use », actuellement en version bêta ouverte, Claude 3.5 Sonnet peut imiter les frappes au clavier, les clics de bouton et les gestes de souris, en simulant essentiellement une personne assise devant un PC. Comme l’explique TechCrunch, le modèle a été entraîné à voir ce qui se passe à l’écran et à utiliser les outils logiciels disponibles pour exécuter des tâches.

Lorsqu’un développeur charge Claude d’utiliser un logiciel informatique et lui donne les accès nécessaires, Claude examine les captures d’écran de ce qui est visible pour l’utilisateur, puis compte le nombre de pixels verticalement ou horizontalement dont il a besoin pour déplacer un curseur afin de cliquer au bon endroit.

– Anthropic

Des cas d’usage prometteurs

Les développeurs peuvent dès à présent tester Computer Use via l’API d’Anthropic, Amazon Bedrock et la plateforme Google Cloud Vertex AI. Des entreprises comme Replit et Canva explorent déjà les possibilités offertes par ce nouveau modèle :

- Replit a utilisé une version préliminaire pour créer un « vérificateur autonome » capable d’évaluer les applications pendant leur construction.

- Canva envisage des moyens d’utiliser Claude 3.5 Sonnet pour assister le processus de conception et d’édition.

Des performances impressionnantes

Selon Anthropic, Claude 3.5 Sonnet se distingue par sa robustesse et ses capacités supérieures en matière de codage, dépassant même le modèle phare GPT-4 d’OpenAI sur certains benchmarks comme SWE-bench Verified. Malgré l’absence d’entraînement explicite, le modèle est capable de s’auto-corriger, de réessayer les tâches en cas d’obstacles et de travailler vers des objectifs nécessitant des dizaines ou des centaines d’étapes.

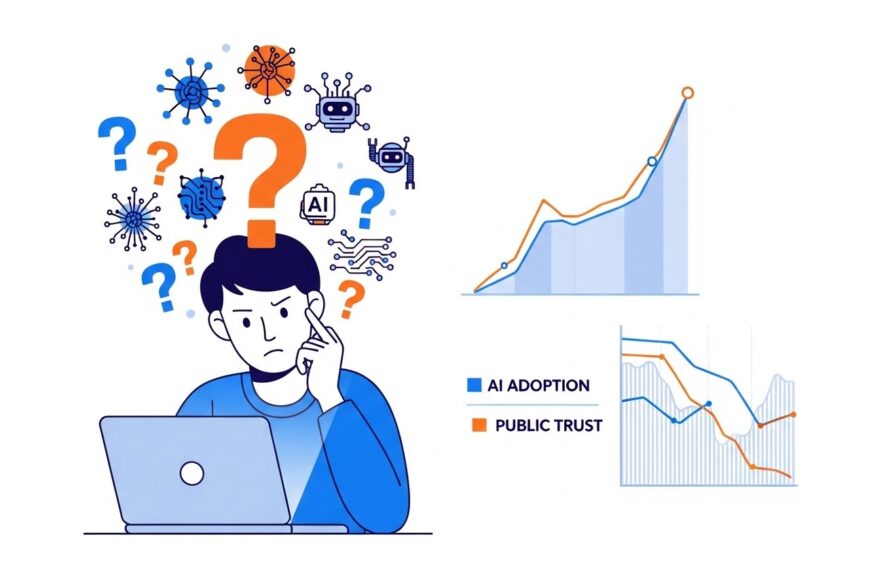

Des enjeux de sécurité à surveiller

Si les avancées d’Anthropic suscitent l’enthousiasme, elles soulèvent aussi des questions quant aux risques potentiels liés à l’accès des IA aux applications de bureau. Une étude récente a montré que des modèles sans cette capacité étaient déjà enclins à adopter des comportements dangereux lorsqu’ils étaient « attaqués ».

Consciente de ces enjeux, Anthropic assure avoir pris des mesures pour dissuader toute utilisation malveillante, comme le fait de ne pas entraîner Claude 3.5 Sonnet sur les captures d’écran et les invites des utilisateurs. Des classifieurs ont également été développés pour éloigner le modèle des actions perçues comme à haut risque.

Il n’existe pas de méthodes infaillibles, et nous évaluerons et adapterons continuellement nos mesures de sécurité pour équilibrer les capacités de Claude avec une utilisation responsable.

– Anthropic

Vers une démocratisation des IA agents ?

Au-delà de Claude 3.5 Sonnet, Anthropic prévoit également de lancer prochainement Claude 3.5 Haiku, une version plus abordable et efficace de son modèle phare. Disponible dans un premier temps en tant que modèle uniquement textuel, il sera ensuite intégré à un package multimodal capable d’analyser à la fois le texte et les images.

Avec ces annonces, Anthropic confirme son ambition de démocratiser l’utilisation des IA agents, ces modèles capables d’automatiser des tâches logicielles complexes. Un marché en plein essor, sur lequel se positionnent déjà des acteurs majeurs comme Microsoft, OpenAI ou encore Amazon via le rachat d’Adept.

Si les promesses sont grandes, il conviendra néanmoins de rester vigilant quant aux potentielles dérives et de s’assurer que le développement de ces technologies s’accompagne de garde-fous éthiques solides. Un défi de taille pour Anthropic et l’ensemble de l’écosystème de l’IA, dont les avancées façonneront indéniablement notre futur numérique.