Dans une avancée majeure pour la démocratisation de l’intelligence artificielle de pointe, OpenAI vient d’annoncer l’ouverture de son modèle de raisonnement o1 via son API. Mais dans un premier temps, seuls certains développeurs triés sur le volet pourront en bénéficier.

Déploiement progressif pour les développeurs « tier 5 »

À partir d’aujourd’hui, o1 commencera à être déployé auprès des développeurs de la catégorie « tier 5 » d’OpenAI. Pour se qualifier dans ce tier, les développeurs doivent dépenser au moins 1 000 dollars avec OpenAI et avoir un compte datant de plus de 30 jours depuis leur premier paiement réussi.

Le modèle o1 remplace le modèle o1-preview qui était déjà disponible dans l’API. Contrairement à la plupart des IA, les modèles dits de « raisonnement » comme o1 s’auto-vérifient efficacement, ce qui les aide à éviter certains écueils qui trompent normalement les modèles.

Des capacités de raisonnement étendues, à un coût

L’inconvénient est qu’ils prennent souvent plus de temps pour arriver à des solutions. Ils sont également assez coûteux, en partie parce qu’ils nécessitent beaucoup de ressources informatiques pour fonctionner.

OpenAI facture 15 dollars pour environ 750 000 mots analysés par o1 et 60 dollars pour environ 750 000 mots générés par le modèle. C’est entre 3 et 4 fois le coût du dernier modèle « non-raisonnant » d’OpenAI, GPT-4o.

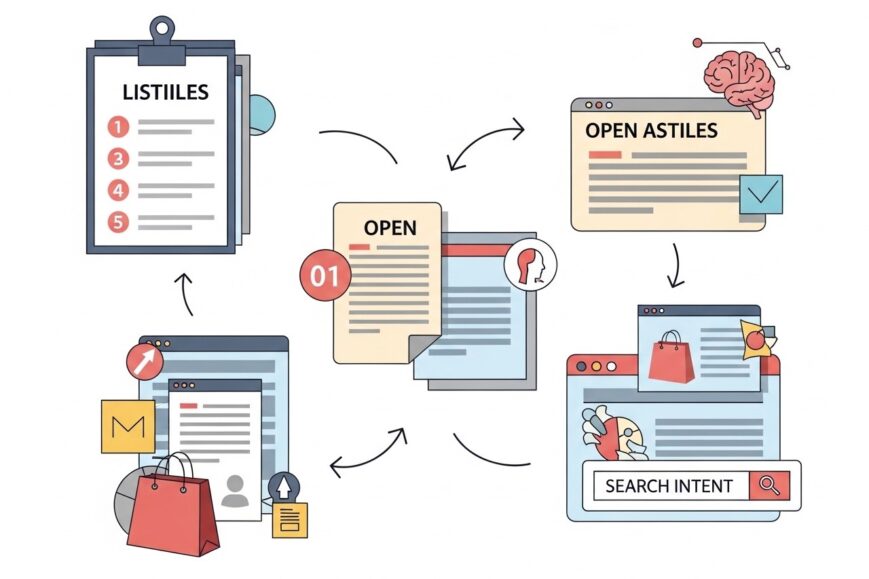

Personnalisation poussée et intégrations

O1 dans l’API OpenAI est beaucoup plus personnalisable que o1-preview, grâce à de nouvelles fonctionnalités comme l’appel de fonction (qui permet de connecter le modèle à des données externes), les messages développeurs (qui permettent aux développeurs d’instruire le modèle sur le ton et le style), et l’analyse d’image.

En plus des sorties structurées, o1 dispose également d’un paramètre d’API, « reasoning_effort », qui permet de contrôler le temps de « réflexion » du modèle avant de répondre à une requête.

Nous déployons l’accès progressivement tout en travaillant à étendre l’accès à des tiers d’utilisation supplémentaires et à augmenter les limites de débit.

OpenAI dans un billet de blog fourni à TechCrunch

Nouvelles versions de modèles et SDKs

OpenAI a également annoncé de nouvelles versions de ses modèles GPT-4o et GPT-4o mini dans le cadre de la Realtime API, l’API d’OpenAI pour la création d’applications avec des réponses vocales générées par l’IA à faible latence.

Les nouveaux modèles, qui se vantent d’une efficacité et d’une fiabilité des données améliorées, sont également moins chers à utiliser, a déclaré OpenAI.

- Support de WebRTC, la norme ouverte pour la création d’applications vocales en temps réel

- Préférence fine-tuning, qui compare des paires de réponses de modèles pour « apprendre » à un modèle à distinguer les réponses préférées des réponses « non préférées ».

- Bêta pour les kits de développement logiciel officiels dans les langages de programmation Go et Java

L’IA à la portée d’un plus grand nombre de développeurs

L’intégration progressive de ces technologies d’IA de pointe dans l’API d’OpenAI marque une étape importante dans la démocratisation de l’IA pour les développeurs.

Bien que réservées pour l’instant à un cercle restreint de développeurs, ces avancées ouvrent la voie à de nouvelles applications innovantes tirant parti des capacités de raisonnement de l’IA, tout en promettant une personnalisation et une intégration accrues.

Reste à voir comment OpenAI gérera la montée en puissance et l’élargissement de l’accès à ces technologies dans les mois à venir, et quelles applications révolutionnaires émergeront de cette démocratisation progressive de l’IA de pointe.