Un rebondissement inattendu vient de se produire dans l’affaire opposant OpenAI, la célèbre société d’intelligence artificielle, au New York Times et au Daily News. Ces deux grands journaux américains ont en effet intenté un procès à OpenAI, l’accusant d’avoir aspiré et utilisé leurs contenus pour entraîner ses modèles d’IA sans autorisation ni compensation. Mais il semblerait que les avocats d’OpenAI aient accidentellement supprimé des données potentiellement cruciales pour l’affaire.

Des machines virtuelles pour examiner les jeux de données d’entraînement

Plus tôt cet automne, OpenAI avait accepté de fournir deux machines virtuelles aux avocats du New York Times et du Daily News afin qu’ils puissent rechercher dans les jeux de données d’entraînement de l’IA la présence éventuelle de contenus protégés par le droit d’auteur appartenant à leurs clients. Les avocats et leurs experts disent avoir passé plus de 150 heures depuis le 1er novembre à éplucher ces données.

Une suppression accidentelle aux lourdes conséquences

Mais le 14 novembre, les ingénieurs d’OpenAI ont apparemment effacé par mégarde toutes les données de recherche stockées sur l’une des machines virtuelles. Si la majorité des données a pu être récupérée, la structure des dossiers et les noms de fichiers ont été irrémédiablement perdus. Les avocats des plaignants estiment donc que ces données sont désormais inutilisables pour déterminer où et comment les articles de presse ont été utilisés pour construire les modèles d’IA.

Les plaignants ont été forcés de recommencer leur travail à zéro, ce qui implique un nombre considérable d’heures de travail humain et de temps de traitement informatique.

Extrait de la lettre des avocats du New York Times et du Daily News

OpenAI nie toute suppression de preuves

Vendredi dernier, les avocats d’OpenAI ont répondu à ces allégations, niant catégoriquement avoir supprimé la moindre preuve. Ils suggèrent plutôt que les plaignants sont responsables d’une mauvaise configuration système qui a entraîné un problème technique.

Les plaignants ont demandé un changement de configuration sur l’une des machines fournies par OpenAI pour effectuer des recherches. Mais la mise en œuvre de ce changement a entraîné la suppression de la structure des dossiers et de certains noms de fichiers sur un disque dur qui était censé servir de cache temporaire. Quoi qu’il en soit, rien n’indique que des fichiers aient été réellement perdus.

Réponse des avocats d’OpenAI

La question centrale de l’usage équitable

Au cœur de cette affaire et d’autres similaires, se trouve la notion d’usage équitable (fair use). OpenAI maintient que l’entraînement de modèles d’IA sur des données publiquement accessibles, y compris des articles de presse, relève de l’usage équitable. Autrement dit, l’entreprise estime qu’elle n’est pas tenue d’obtenir une licence ou de payer pour utiliser ces contenus, même si elle tire des revenus des modèles entraînés avec.

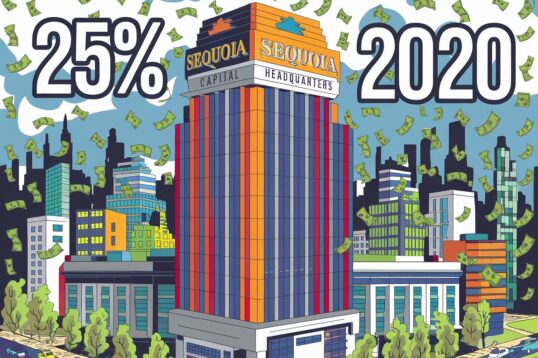

Pourtant, OpenAI a signé des accords de licence avec un nombre croissant d’éditeurs de presse, dont :

- Associated Press

- Axel Springer (propriétaire de Business Insider)

- Financial Times

- Dotdash Meredith (société mère de People)

- News Corp

Les termes de ces accords restent confidentiels, mais selon certaines sources, Dotdash recevrait au moins 16 millions de dollars par an de la part d’OpenAI.

De nombreuses questions encore sans réponse

Cette affaire soulève de nombreuses interrogations sur les pratiques des entreprises d’IA comme OpenAI en matière de droits d’auteur et d’utilisation des contenus pour l’entraînement de leurs modèles. Jusqu’où s’étend la notion d’usage équitable dans ce contexte? Les éditeurs et créateurs de contenus sont-ils suffisamment protégés et rémunérés? Comment assurer plus de transparence sur les jeux de données utilisés tout en préservant les secrets industriels des entreprises d’IA?

Le procès intenté par le New York Times et le Daily News à OpenAI pourrait bien faire jurisprudence et contribuer à clarifier le cadre juridique et éthique dans lequel doit se développer l’IA générative. Mais vu la complexité des enjeux, il faudra sans doute encore de nombreux débats et batailles juridiques avant de trouver un équilibre satisfaisant entre les intérêts des différentes parties prenantes. Une chose est sûre : cette affaire sera suivie de très près par tout l’écosystème de l’IA et des médias.