À l’approche des élections européennes, les géants de la technologie redoublent de vigilance face aux tentatives de manipulation de l’opinion en ligne. OpenAI et Meta viennent de révéler avoir déjoué plusieurs opérations d’influence étrangère exploitant l’intelligence artificielle et les réseaux sociaux ces derniers mois, menées depuis la Russie, la Chine, Israël et l’Iran.

OpenAI, la start-up derrière le célèbre chatbot ChatGPT, a annoncé avoir perturbé cinq campagnes cherchant à utiliser ses modèles d’IA pour soutenir des activités trompeuses sur Internet. De son côté, Meta, maison-mère de Facebook et Instagram, a publié son rapport trimestriel sur les « comportements inauthentiques coordonnés » détectés sur ses plateformes.

Quand l’IA se met au service de la désinformation

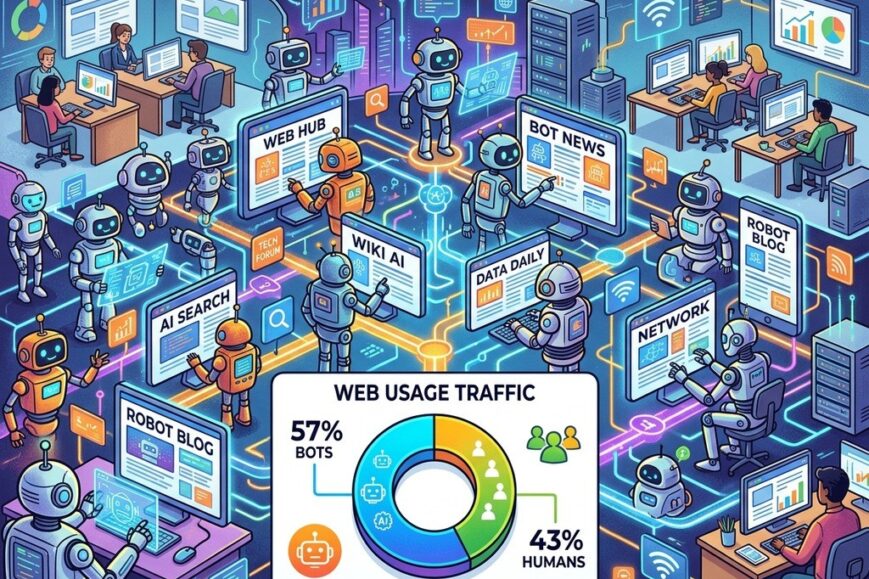

Si les techniques traditionnelles de propagande restent largement employées, l’intelligence artificielle apparaît comme un nouvel outil prisé des acteurs malveillants. Génération de faux commentaires, d’articles multilingues, de profils sur les réseaux sociaux… Les possibilités offertes par l’IA pour tromper et manipuler à grande échelle inquiètent.

Jusqu’à présent, nous n’avons pas vu de nouvelles tactiques basées sur l’IA générative qui entraveraient notre capacité à perturber les réseaux adverses qui en sont à l’origine.

Meta, mai 2023

Toutefois, Meta se veut rassurante, affirmant que l’IA n’empêche pas pour l’instant de détecter et contrer ces opérations. Mais la technologie évoluant rapidement, une vigilance de tous les instants s’impose.

La Russie et Israël vantent leurs « exploits » militaires

Parmi les campagnes exposées, on retrouve « Doppelganger », une opération russe active depuis 2022 visant initialement à saper le soutien international à l’Ukraine. Malgré les efforts de détection, elle persiste en diversifiant ses modes d’action, utilisant l’IA d’OpenAI pour générer des commentaires et articles en plusieurs langues.

De son côté, Israël cherche à redorer l’image de ses opérations militaires à Gaza, alors que la Cour Pénale Internationale a émis des mandats d’arrêt contre ses dirigeants pour crimes de guerre. La société STOIC a ainsi orchestré la publication de contenus générés par IA sur les réseaux sociaux pour vanter l’armée israélienne et accuser ses détracteurs d’antisémitisme.

La Chine sème le trouble à l’international

Les opérations d’influence chinoises révélées par OpenAI et Meta semblent poursuivre des objectifs distincts. « Spamouflage », liée selon le FBI au ministère chinois de la Sécurité publique, viserait les dissidents établis à l’étranger via des contenus multilingues sur différentes plateformes.

Une autre campagne chinoise cherche à attiser les velléités indépendantistes de la communauté Sikh en Inde et dans sa diaspora, en pleine période électorale dans le pays. Pékin semble ainsi vouloir déstabiliser son rival régional par tous les moyens.

Vers une meilleure réponse face à la guerre informationnelle

Si Meta et OpenAI se félicitent d’avoir pu contrer ces opérations avant qu’elles ne touchent un large public, la menace demeure. Les États ne peuvent rester passifs face à cette guerre de l’information d’un nouveau genre, mêlant techniques classiques de désinformation et outils d’IA de pointe.

En France, la création récente de Viginum, une agence gouvernementale dédiée à la lutte contre les manipulations de l’information, va dans le bon sens. Face à l’évolution rapide des menaces, les démocraties doivent s’adapter et coopérer pour préserver l’intégrité de leurs processus électoraux et le libre arbitre des citoyens.

- Les géants de la tech luttent contre les opérations d’influence exploitant l’IA

- Russie, Chine, Israël… Quand les États sèment la désinformation en ligne

- Face à la guerre de l’information, les démocraties doivent riposter