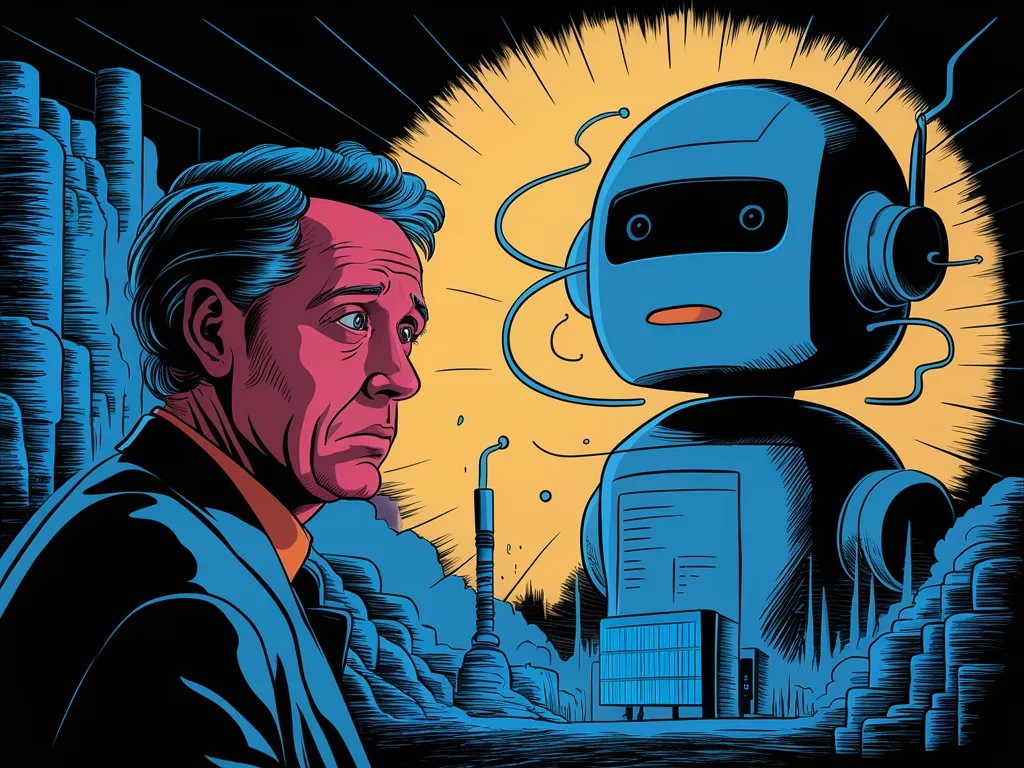

Le monde de l’intelligence artificielle vient de connaître un séisme : Geoffrey Hinton, considéré comme le parrain de l’IA, a annoncé son départ de Google. Mais plus surprenant encore, il exprime maintenant des regrets quant à son travail et met en garde contre les dangers des chatbots IA qu’il a contribué à développer. Ses inquiétudes soulèvent des questions cruciales sur les risques potentiels de ces technologies et la nécessité d’une réglementation éthique.

Le pionnier de l’IA tire la sonnette d’alarme

Geoffrey Hinton n’est pas n’importe qui dans le monde de l’IA. Ses recherches sur l’apprentissage profond et les réseaux de neurones ont posé les bases des systèmes d’IA modernes comme ChatGPT. Chez Google, il a dirigé l’équipe Google Brain, à la pointe de l’innovation. Son départ et ses mises en garde ont donc un poids considérable.

En ce moment, ils ne sont pas plus intelligents que nous, pour autant que je sache. Mais je pense qu’ils le seront bientôt.

Geoffrey Hinton

Selon Hinton, les chatbots IA pourraient bientôt dépasser l’intelligence humaine, avec des risques « assez effrayants ». Il craint notamment que des acteurs malveillants exploitent cette technologie pour diffuser de la désinformation à grande échelle, sans qu’on puisse distinguer le vrai du faux.

Les multiples dangers des chatbots IA

Au-delà de la désinformation, les chatbots IA soulèvent de nombreux autres risques potentiels, notamment :

- Les risques de sécurité et de piratage, les chatbots pouvant être détournés à des fins malveillantes

- Les atteintes à la vie privée, avec la collecte massive de données personnelles

- Les biais et discriminations provenant des données d’entraînement des IA

- La déshumanisation de certaines relations et interactions sociales

- La perte potentielle de nombreux emplois automatisés par l’IA

Face à ces risques, il apparaît urgent d’établir un cadre éthique et réglementaire pour le développement et le déploiement de l’IA. Cela passe par plus de transparence sur le fonctionnement de ces systèmes, des audits externes, le respect de la vie privée et la possibilité pour les utilisateurs de ne pas interagir avec des IA.

Quelle place pour l’IA dans notre société ?

Au-delà des risques, le départ de Geoffrey Hinton pose la question de la place que nous voulons donner à l’IA dans notre société. Voulons-nous d’une automatisation à outrance, au détriment de l’emploi et des relations humaines ? Ou souhaitons-nous utiliser l’IA comme un outil au service de l’humain, avec des garde-fous éthiques ?

Le débat est ouvert, mais une chose est sûre : nous ne pouvons laisser la technologie décider seule de notre avenir. Les géants de la tech comme Google, mais aussi les pouvoirs publics et la société civile, doivent se saisir dès maintenant de ces enjeux cruciaux. Car comme le rappelle Geoffrey Hinton, « ce que nous développons pourrait nous échapper si nous ne faisons pas attention ».

L’IA en quelques notions clés

Vous n’êtes pas encore familier avec l’IA ? Pas de panique, voici quelques notions pour mieux comprendre les enjeux :

- Intelligence artificielle : capacité des machines à effectuer des tâches qui nécessitent normalement une intelligence humaine (reconnaissance visuelle, traitement du langage, prise de décision…)

- Apprentissage profond (deep learning) : méthode d’IA basée sur des réseaux de neurones artificiels, qui « apprennent » à partir de vastes ensembles de données

- Chatbot : agent conversationnel qui dialogue avec les humains de manière naturelle, le plus souvent par écrit

- Biais algorithmique : reproduit dans les décisions de l’IA des biais (sexistes, racistes…) présents dans les données d’entraînement

- Éthique de l’IA : réflexion sur les principes moraux qui doivent guider le développement et l’usage de l’IA (transparence, justice, respect de la vie privée…)

Avec ces clés de compréhension, vous serez mieux armés pour suivre les prochains développements de cette technologie fascinante, mais qui ne doit pas occulter l’humain. Car comme le dit un autre pionnier de l’IA, Yoshua Bengio : « L’IA est un outil formidable, mais ce n’est qu’un outil. C’est à nous de décider quel monde nous voulons construire avec. »

Face à ces risques, il apparaît urgent d’établir un cadre éthique et réglementaire pour le développement et le déploiement de l’IA. Cela passe par plus de transparence sur le fonctionnement de ces systèmes, des audits externes, le respect de la vie privée et la possibilité pour les utilisateurs de ne pas interagir avec des IA.

Quelle place pour l’IA dans notre société ?

Au-delà des risques, le départ de Geoffrey Hinton pose la question de la place que nous voulons donner à l’IA dans notre société. Voulons-nous d’une automatisation à outrance, au détriment de l’emploi et des relations humaines ? Ou souhaitons-nous utiliser l’IA comme un outil au service de l’humain, avec des garde-fous éthiques ?

Le débat est ouvert, mais une chose est sûre : nous ne pouvons laisser la technologie décider seule de notre avenir. Les géants de la tech comme Google, mais aussi les pouvoirs publics et la société civile, doivent se saisir dès maintenant de ces enjeux cruciaux. Car comme le rappelle Geoffrey Hinton, « ce que nous développons pourrait nous échapper si nous ne faisons pas attention ».

L’IA en quelques notions clés

Vous n’êtes pas encore familier avec l’IA ? Pas de panique, voici quelques notions pour mieux comprendre les enjeux :

- Intelligence artificielle : capacité des machines à effectuer des tâches qui nécessitent normalement une intelligence humaine (reconnaissance visuelle, traitement du langage, prise de décision…)

- Apprentissage profond (deep learning) : méthode d’IA basée sur des réseaux de neurones artificiels, qui « apprennent » à partir de vastes ensembles de données

- Chatbot : agent conversationnel qui dialogue avec les humains de manière naturelle, le plus souvent par écrit

- Biais algorithmique : reproduit dans les décisions de l’IA des biais (sexistes, racistes…) présents dans les données d’entraînement

- Éthique de l’IA : réflexion sur les principes moraux qui doivent guider le développement et l’usage de l’IA (transparence, justice, respect de la vie privée…)

Avec ces clés de compréhension, vous serez mieux armés pour suivre les prochains développements de cette technologie fascinante, mais qui ne doit pas occulter l’humain. Car comme le dit un autre pionnier de l’IA, Yoshua Bengio : « L’IA est un outil formidable, mais ce n’est qu’un outil. C’est à nous de décider quel monde nous voulons construire avec. »