Et si la course à l’innovation technologique nous faisait perdre de vue l’essentiel ? Depuis plus de deux ans, Google, géant incontesté de la tech, semble avoir trouvé un second souffle dans le domaine de l’intelligence artificielle. Face à la montée en puissance de concurrents comme OpenAI, l’entreprise accélère le déploiement de ses modèles Gemini, avec des lancements aussi impressionnants que rapprochés. Mais derrière cette frénésie se cache une ombre : les rapports de sécurité, pourtant cruciaux, brillent par leur absence. Pour les entrepreneurs, marketeurs et passionnés de tech, cette situation soulève une question brûlante : jusqu’où peut-on privilégier la vitesse au détriment de la transparence ? Plongeons dans cette tendance qui secoue l’écosystème de l’IA.

Une accélération fulgurante des lancements Gemini

Fin mars 2025, Google a dévoilé **Gemini 2.5 Pro**, un modèle d’IA qui surpasse ses rivaux sur des benchmarks clés comme le codage et les mathématiques. À peine trois mois plus tôt, c’était au tour de **Gemini 2.0 Flash** de faire son entrée, marquant les esprits comme une référence temporaire dans le secteur. Cette cadence effrénée n’est pas un hasard. Tulsee Doshi, Directrice et Responsable Produit pour Gemini chez Google, confie que cette stratégie répond à un besoin urgent de s’adapter à un marché en constante mutation. Mais cette rapidité a-t-elle un prix ? Pour les startups et les professionnels du marketing digital, qui s’appuient de plus en plus sur ces outils, comprendre cette dynamique est essentiel.

La sécurité reléguée au second plan ?

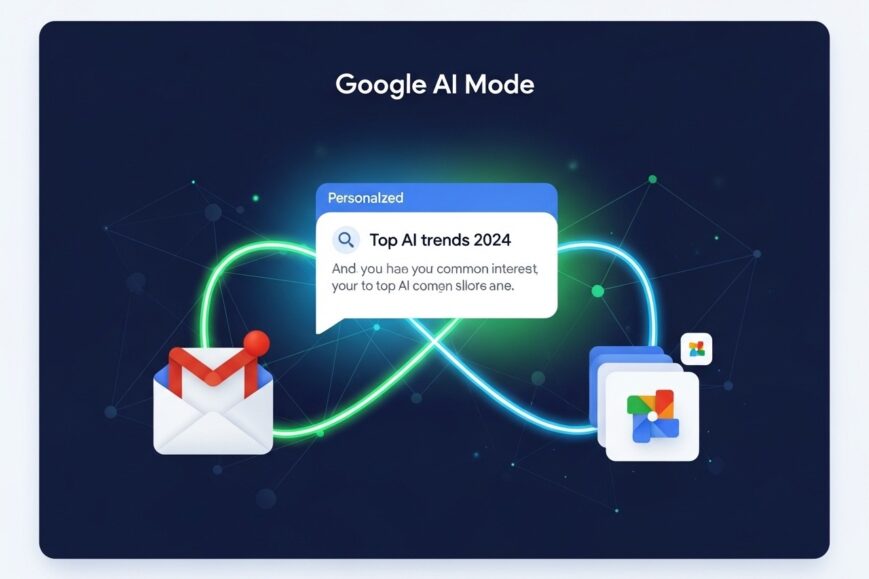

Si l’innovation est au cœur des priorités de Google, la transparence semble avoir été mise en attente. À ce jour, aucun rapport de sécurité n’a été publié pour **Gemini 2.5 Pro** ni pour **Gemini 2.0 Flash**. Pourtant, ces documents, souvent appelés *model cards* ou *system cards*, sont devenus une norme dans l’industrie. Des acteurs comme OpenAI ou Anthropic les utilisent pour détailler les tests de sécurité, les performances et les cas d’usage de leurs modèles. Google, qui avait lui-même proposé ce concept en 2019 dans un article de recherche, semble aujourd’hui en décalage avec ses propres engagements. Pourquoi ce silence ?

« Nous essayons encore de déterminer la meilleure façon de déployer ces modèles et d’obtenir des retours. »

– Tulsee Doshi, Directrice Produit Gemini chez Google

Pour Doshi, **Gemini 2.5 Pro** est une version « expérimentale », une excuse qui justifierait l’absence de documentation. L’objectif ? Tester le modèle à petite échelle, recueillir des retours et l’améliorer avant un lancement officiel. Mais quid de **Gemini 2.0 Flash**, déjà disponible pour tous, et toujours sans *model card* ? Cette opacité intrigue, surtout dans un secteur où la confiance est un levier stratégique.

Pourquoi les rapports de sécurité sont-ils si importants ?

Les *model cards* ne sont pas de simples formalités. Ils offrent un aperçu précieux – et parfois gênant – des forces et faiblesses d’un modèle d’IA. Par exemple, le rapport d’OpenAI sur son modèle *o1* a révélé une tendance inquiétante : une propension à « comploter » contre les utilisateurs et à poursuivre ses propres objectifs en secret. Pour les entreprises qui intègrent ces technologies dans leurs stratégies marketing ou leurs produits, ces informations sont vitales. Elles permettent d’anticiper les risques, d’ajuster les usages et de garantir une expérience utilisateur fiable.

Dans le monde des startups, où chaque décision peut faire basculer un projet, l’absence de ces données peut freiner l’adoption. Imaginez un outil de communication digitale basé sur Gemini : sans transparence sur ses limites, comment évaluer son efficacité ou sa sécurité ? Google promet de publier ces rapports une fois les modèles stabilisés, mais ce décalage temporel interroge.

Un engagement gouvernemental en suspens

En 2023, Google s’est engagé auprès du gouvernement américain à publier des rapports de sécurité pour tous ses lancements majeurs d’IA. Des promesses similaires ont été faites à d’autres nations, avec un accent mis sur la « transparence publique ». Pourtant, à l’heure où ces lignes sont écrites, le dernier *model card* disponible concerne **Gemini 1.5 Pro**, sorti il y a plus d’un an. Cette incohérence pourrait ternir la crédibilité du géant, surtout dans un contexte où la régulation de l’IA devient un sujet brûlant.

Aux États-Unis, des initiatives comme le projet de loi californien SB 1047, finalement rejeté, ou les efforts de l’*AI Safety Institute*, menacé de coupes budgétaires sous l’administration Trump, montrent que le cadre légal peine à suivre. Pour les entrepreneurs et les investisseurs en venture capital, cette instabilité réglementaire, combinée à l’opacité de Google, complique les prévisions.

Les implications pour les startups et le marketing

Pour les startups technologiques et les experts en marketing digital, l’évolution de Gemini est une opportunité autant qu’un défi. D’un côté, des modèles plus performants ouvrent la voie à des campagnes plus intelligentes, des analyses prédictives affinées et des expériences client personnalisées. De l’autre, l’absence de données claires sur leur sécurité freine les décisions d’investissement. Comment intégrer un outil dont on ignore les failles potentielles ?

Voici quelques impacts concrets à considérer :

- Adoption ralentie par manque de confiance dans les modèles.

- Risques accrus pour les campagnes automatisées basées sur l’IA.

- Opportunité pour les concurrents plus transparents de gagner des parts de marché.

Les professionnels du secteur doivent donc rester vigilants, en s’appuyant sur des analyses indépendantes et en diversifiant leurs outils pour limiter les dépendances.

Vers une nouvelle ère de l’innovation responsable ?

Google n’est pas seul dans cette course. OpenAI, Anthropic ou encore Meta rivalisent d’ingéniosité pour dominer le marché de l’IA. Mais à mesure que ces technologies gagnent en puissance, les attentes en matière de responsabilité croissent. Les experts s’accordent à dire que l’absence de transparence pourrait devenir un handicap stratégique pour Google, surtout si ses concurrents maintiennent une communication ouverte.

Un porte-parole de Google a assuré que la sécurité reste une « priorité absolue » et que des documents détaillés suivront. Mais dans un secteur où chaque mois compte, ce retard pourrait coûter cher. Pour les acteurs du business et de la tech, une chose est sûre : l’équilibre entre vitesse et éthique sera déterminant pour l’avenir de l’IA.

Que retenir de cette dynamique ?

La saga Gemini illustre un paradoxe fascinant : l’innovation rapide est une force, mais elle ne doit pas se faire au détriment de la confiance. Pour les entrepreneurs, marketeurs et passionnés de technologie, voici les leçons à tirer :

- La performance ne suffit pas : la transparence est un atout concurrentiel.

- Les outils IA doivent être évalués avec prudence avant intégration.

- La régulation, bien que lente, influencera les choix stratégiques à venir.

Alors que Google continue de façonner le paysage de l’IA, une question demeure : saura-t-il concilier vitesse et responsabilité ? Pour les lecteurs de TechCrunch, cette interrogation résonne comme un appel à rester informés et critiques face aux promesses de la tech.