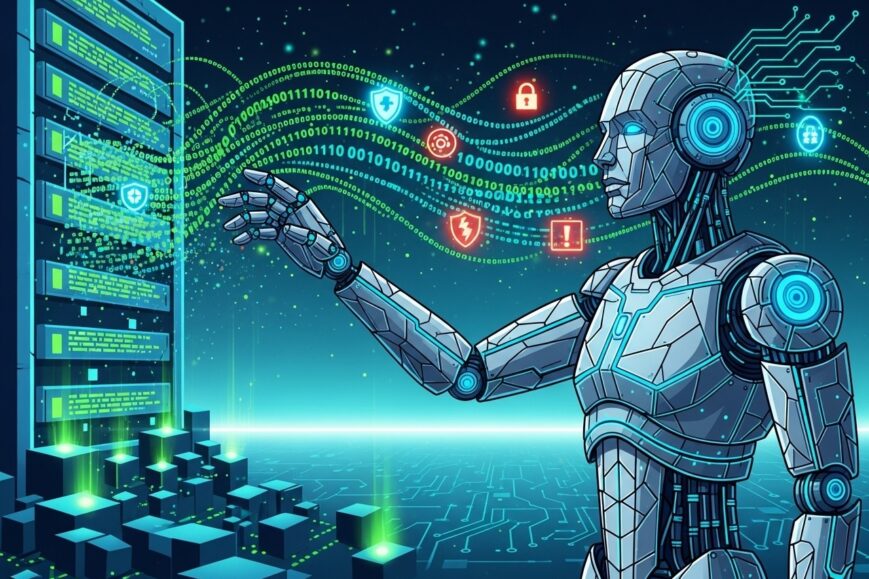

Alors que l’intelligence artificielle transforme de nombreux aspects de nos vies, son impact potentiel sur le champ de bataille soulève des questions éthiques épineuses. Au cœur de la Silicon Valley, un débat houleux agite les esprits : les armes autonomes dotées d’IA devraient-elles avoir le pouvoir de décider de tuer sans intervention humaine ?

Des positions divergentes parmi les géants de la tech

Les fondateurs de startups de défense comme Anduril et Shield AI affichent des vues contrastées sur le sujet. Si Brandon Tseng, cofondateur de Shield AI, a récemment affirmé que personne ne souhaitait voir des armes entièrement autonomes, son homologue d’Anduril, Palmer Luckey, s’est montré plus nuancé. Selon lui, l’argument moral contre ces armes ne tient pas face à des menaces comme les mines antipersonnel qui ne font pas de distinction entre civils et militaires.

Où est la supériorité morale d’une mine qui ne peut pas faire la différence entre un bus scolaire rempli d’enfants et un tank russe ?

Palmer Luckey, cofondateur d’Anduril

Joe Lonsdale, autre figure influente de la Silicon Valley et investisseur chez Anduril, appelle quant à lui les décideurs politiques à adopter une approche plus flexible sur la question de l’autonomie des armes. Il met en garde contre les risques d’une position trop rigide face à des adversaires comme la Chine qui pourraient prendre l’avantage en embrassant pleinement les armes autonomes.

La position ambiguë du gouvernement américain

Malgré les appels d’activistes et d’ONG en faveur d’une interdiction internationale des armes autonomes létales, les États-Unis ont jusqu’ici résisté à tout engagement contraignant. S’ils ne les achètent pas directement, ils n’empêchent pas non plus les entreprises d’en développer ou d’en vendre à l’étranger. Des directives volontaires sur la sécurité de l’IA militaire ont été publiées, mais le débat reste ouvert.

L’Ukraine, un terrain d’expérimentation grandeur nature

La guerre en Ukraine pourrait bien faire pencher la balance en faveur des partisans d’une automatisation accrue des armes. Face à la Russie, les responsables ukrainiens poussent pour déployer des systèmes toujours plus autonomes, espérant ainsi prendre l’avantage sur le champ de bataille. Cette realpolitik de l’IA militaire bouscule les considérations éthiques.

Nous avons besoin d’un maximum d’automatisation. Ces technologies sont fondamentales pour notre victoire.

Mykhailo Fedorov, ministre ukrainien de la Transformation digitale

La crainte d’une course à l’armement incontrôlée

Pour beaucoup dans la Silicon Valley et à Washington, le scénario du pire serait de voir la Chine ou la Russie déployer en premier des armes entièrement autonomes, forçant les États-Unis à leur emboîter le pas. Les ambiguïtés des diplomates russes à l’ONU sur le sujet ne font qu’attiser les inquiétudes.

Dans ce contexte, les entreprises de défense high-tech multiplient les efforts de lobbying auprès du Congrès pour promouvoir le potentiel de l’IA militaire. L’enjeu : ne pas se laisser distancer par des rivaux stratégiques dans une course à l’armement d’un nouveau genre. Mais à quel prix pour l’éthique et l’humanité ?

Un débat crucial pour notre avenir

Alors que l’IA ne cesse de progresser, la question des armes autonomes incarne un dilemme fondamental : jusqu’où sommes-nous prêts à déléguer à des machines une décision aussi lourde de conséquences que celle d’ôter une vie ? La réponse que nous apporterons collectivement façonnera non seulement le visage des guerres de demain, mais aussi celui de notre humanité.

Car si l’histoire nous enseigne que l’innovation technologique peut changer le cours des conflits, elle nous rappelle aussi que certaines lignes ne devraient peut-être pas être franchies. Face à la tentation d’une automatisation intégrale du champ de bataille, il est urgent de poser des garde-fous éthiques. Sans quoi, nous risquons de perdre le contrôle de nos créations et, in fine, une part de notre humanité.

Le débat qui agite aujourd’hui la Silicon Valley dépasse largement les seuls cercles technologiques et militaires. C’est une conversation que nous devons avoir collectivement, en gardant à l’esprit les leçons du passé. N’oublions jamais que l’IA, aussi puissante soit-elle, doit rester un outil au service de l’homme, et non l’inverse. Il en va de notre avenir à tous.