Imaginez un instant que votre site web, soigneusement conçu pour attirer des visiteurs humains, soit soudain envahi par une armée de robots voraces, aspirant vos données à une vitesse folle. C’est exactement ce que vit la Fondation Wikimedia en ce moment. Selon un récent article de TechCrunch, la demande en bande passante de Wikimedia Commons a bondi de **50 %** depuis janvier 2024. La cause ? Pas une soudaine soif de connaissance de l’humanité, mais des **robots IA** affamés de données pour entraîner leurs modèles. Ce phénomène, loin d’être anodin, soulève des questions cruciales pour les entrepreneurs, les marketeurs et les passionnés de technologie. Comment l’essor de l’intelligence artificielle redéfinit-il l’équilibre du web ouvert ? Et surtout, quelles leçons pouvons-nous en tirer pour nos propres projets numériques ? Plongeons dans cette problématique fascinante.

Une Explosion de Consommation Inattendue

La Fondation Wikimedia, qui chapeaute Wikipédia et une ribambelle d’autres projets collaboratifs, a tiré la sonnette d’alarme. Dans un billet de blog publié récemment, elle explique que cette hausse spectaculaire de la bande passante n’est pas liée à une curiosité humaine grandissante, mais à des **scrapers automatisés**. Ces outils, souvent utilisés pour collecter des masses de données à des fins d’entraînement d’IA, ciblent particulièrement Wikimedia Commons, un réservoir libre d’images, vidéos et fichiers audio. Résultat : une surcharge qui met à rude épreuve l’infrastructure conçue pour des pics de trafic humains, comme lors d’événements médiatiques majeurs.

Ce n’est pas une simple anecdote technique. Pour les startups et les entreprises qui s’appuient sur des ressources ouvertes, cette situation illustre un défi croissant : comment gérer l’appétit insatiable des algorithmes tout en préservant une expérience utilisateur fluide ?

Pourquoi les Robots IA Sont-ils si Gourmands ?

Pour comprendre cette explosion, il faut plonger dans les habitudes des crawlers. Contrairement aux humains, qui se concentrent sur des sujets populaires ou spécifiques, les bots adoptent une approche bien plus exhaustive. Ils explorent en masse, y compris les pages les moins visitées, ce qui génère un trafic dit « coûteux ». Wikimedia explique que 65 % du trafic le plus gourmand en ressources provient de ces automates, bien qu’ils ne représentent que 35 % des vues totales. Pourquoi cette disproportion ? Parce que les contenus fréquemment consultés restent en cache près des utilisateurs, tandis que les données rares, stockées dans des centres de données centraux, demandent plus d’efforts pour être servies.

« Les lecteurs humains se focalisent sur des sujets précis, souvent similaires, tandis que les bots lisent en masse, y compris les pages moins populaires. »

– Fondation Wikimedia

Cette différence de comportement a un coût direct : plus de ressources mobilisées, plus de temps passé par les équipes techniques à bloquer ces intrus, et une facture cloud qui grimpe en flèche. Pour une organisation à but non lucratif comme Wikimedia, c’est un casse-tête. Mais pour une startup ou une PME, cela pourrait carrément menacer la viabilité d’un projet.

Un Enjeu pour l’Open Web

Ce n’est pas qu’une question de technique ou de budget. Ce boom des crawlers IA met en péril l’idée même d’un internet ouvert et accessible à tous. Des voix comme celle de Drew DeVault, ingénieur logiciel et défenseur de l’open source, s’élèvent pour dénoncer l’irrespect des fichiers *robots.txt*, ces balises censées repousser les bots indésirables. Gergely Orosz, auteur du blog *Pragmatic Engineer*, a lui aussi vu ses propres projets submergés par des scrapers venant de géants comme Meta.

Pour les marketeurs et les créateurs de contenu, c’est un signal d’alarme. Si les ressources gratuites comme Wikimedia Commons deviennent impraticables à cause des coûts ou des restrictions, cela pourrait pousser de nombreux acteurs à se retrancher derrière des paywalls ou des systèmes de connexion. Adieu l’accès libre, bonjour les barrières. Un cauchemar pour les stratégies de contenu ouvertes et les campagnes SEO basées sur des données accessibles.

Les Réponses Face à la Menace

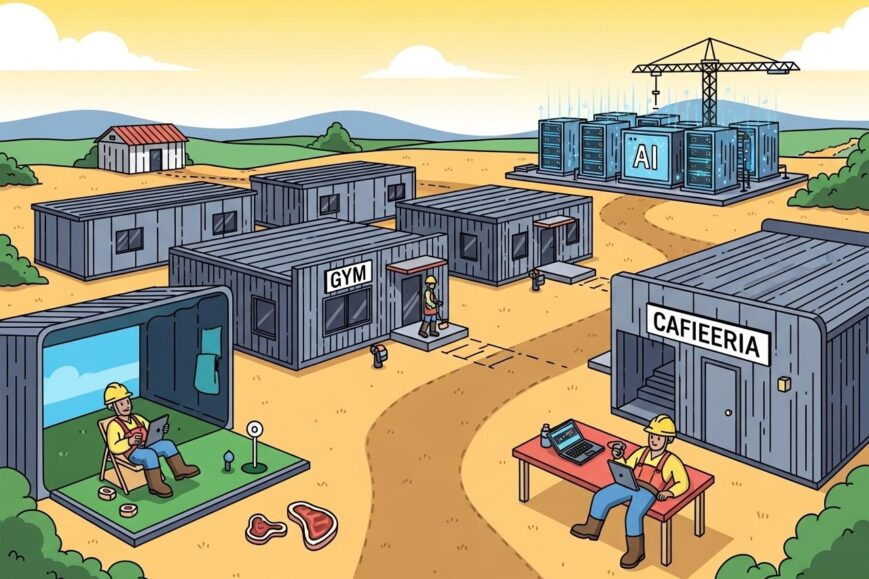

Face à cette invasion, les réactions ne se font pas attendre. Chez Wikimedia, les équipes techniques passent des heures à bloquer les crawlers pour protéger les utilisateurs humains. Mais d’autres vont plus loin. Certains développeurs contre-attaquent avec des solutions ingénieuses, comme des pièges à bots ou des contenus générés pour ralentir les scrapers. Cloudflare, par exemple, a lancé *AI Labyrinth*, un outil qui utilise des contenus artificiels pour désorienter les robots.

Cette lutte ressemble à un jeu du chat et de la souris. Pour les entrepreneurs tech, c’est une opportunité : développer des outils pour contrer les abus d’IA pourrait devenir un marché florissant. Mais c’est aussi un avertissement : ignorer cette tendance pourrait coûter cher, littéralement.

- Augmentation des coûts d’hébergement pour les sites ciblés.

- Risque de fermeture des ressources ouvertes aux bots.

- Nécessité de nouvelles stratégies de protection des données.

Quel Impact pour les Startups et le Marketing ?

Pour les startups et les professionnels du marketing digital, cette situation n’est pas qu’un débat technique : elle touche au cœur de leurs activités. Si vous utilisez des données ouvertes pour analyser les tendances, alimenter vos campagnes ou entraîner vos propres modèles IA, préparez-vous à des obstacles. Les coûts croissants pourraient limiter l’accès à ces ressources, obligeant à repenser les budgets ou à chercher des alternatives payantes.

Et si vous gérez un site ou une plateforme ? La menace des crawlers pourrait vous pousser à investir dans des défenses robustes, comme des pare-feu avancés ou des systèmes de détection d’IA. Un exemple concret : imaginez une jeune pousse dans la communication digitale qui voit son serveur saturé par des bots. Sans action rapide, c’est l’expérience client qui trinque, et avec elle, la réputation.

Vers une Nouvelle Ère du Web ?

Alors, que nous réserve l’avenir ? Si les crawlers IA continuent leur ascension, le web tel qu’on le connaît pourrait se transformer. Les sites gratuits et ouverts risquent de devenir rares, remplacés par des écosystèmes fermés. Pour les passionnés de technologie et de business, c’est un défi à relever : innover pour protéger l’open web tout en tirant parti de l’IA.

En attendant, une chose est sûre : l’équilibre entre humains et machines sur internet est en train de basculer. À nous, entrepreneurs, marketeurs et créateurs, de trouver notre place dans ce nouvel ordre numérique.